Interactive Dialogue Learning

以「智慧工廠」為主旨,設計一任務輔助機器人(interactive dialogue system),在使用者組裝Meccanoid 2.0機器人的過程中給予協助,針對使用者提出之組裝問題提供操作指示。我們將組裝任務切分為多個步驟,組裝過程中透過影像辨識判斷使用者正在組裝之步驟,當使用者發問時,除了分析使用者的問句,也透過影像辨識得知使用者組裝步驟,針對該步驟可能產生之問題提出相對應解答,以期幫助使用者解決組裝難題。

在聊天機器人這個研究領域當中,研究的方向可以依照不同目的區分成三個階段:

第一階段是自然語言理解(Natural Language Understanding)、在此階段聊天機器人會將從使用者終端接收到的文字轉換成預先定義好的意圖(Intention)與槽填充(Slot filling),為了可以跟聊天機器人直接的對話,大多會使用自動語音識別(Automatic Speech Recognition)將收到的語音先轉換成文字再進行自然語言理解(NLU)。

在第二個階段是對話管理(Dialogue Manager),當我們經過自然語言理解(NLU)後取得使用者的意圖(Intention)與曹填充(Slot filling),對話管理(DM)可以依據這兩者,決定要如何回應使用者或是根據使用者的意圖(Intention)提供服務。在這個階段的輸出通常是系統動作(System Action) 而不是自然語言。舉例來說像是查詢資料庫、外送飲料訂單或是餐廳訂位等等。

第三階段是自然語言產生(Natural Language Generator),在這個階段會依照對話管理(DM)的輸出來產生適合人類閱讀與理解的自然語言。舉例來說將外送這個系統動作(System Action)轉換成自然語言:「您訂的10杯珍珠奶茶將於30分鐘內送達,請耐心等候~」

Multi-Modality Dialogue System:

本組主要在參與和台大智慧聯網創新研究中心(NTU IOX center)合作的相關計畫,蔡宗翰老師在IOX center作為Interactive Dialogue Learning計畫項目的主持人,與計畫共同主持人李宏毅老師已合作多年,致力研究對話系統發展的可能性。

本年度中心的計畫主題為智慧製造(Smart Manufacturing),須以機器人組裝為課題去展示各組的技術在智慧製造中的應用。下圖是美國時下流行的玩具機器人Meccanoid,也是本次用來demo的物件

Meccanoid一共有9個主部件如圖所示,部件間都需使用不同型號的螺絲鎖合,本組的開發的對話系統會在使用者組裝此機器人時給予協助。

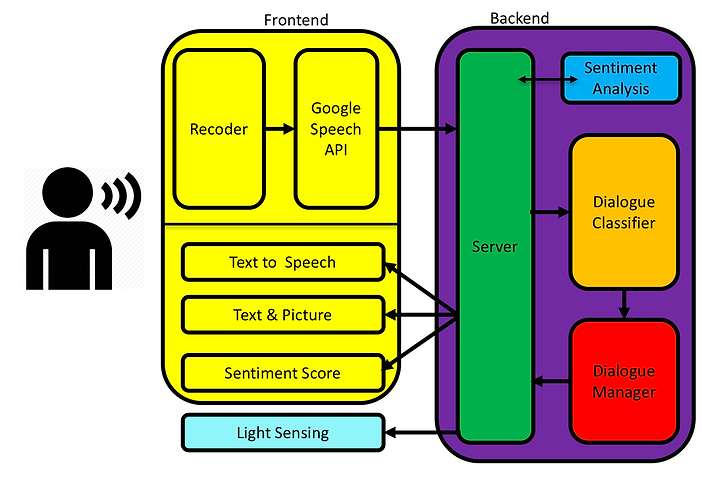

此為我們的系統架構圖,當使用者提出問題後,會經由Google Speech API做語音辨識轉成文字傳送給後端。

-

情緒分析(Sentiment Analysis)會判斷使用者的問題去輸出一個介於0~1之間的情緒值,值越高代表情緒越正面。

-

對話分類器(Dialogue Classifier)會將輸入的問題進行意圖(Intent)分類。

-

對話管理(Dialogue Manager)會藉由對話分類的結果去決定系統回覆(System Response)

-

另外有一個光指引(Light Sensing)會透過不同的LED燈模組去給予使用者指引。

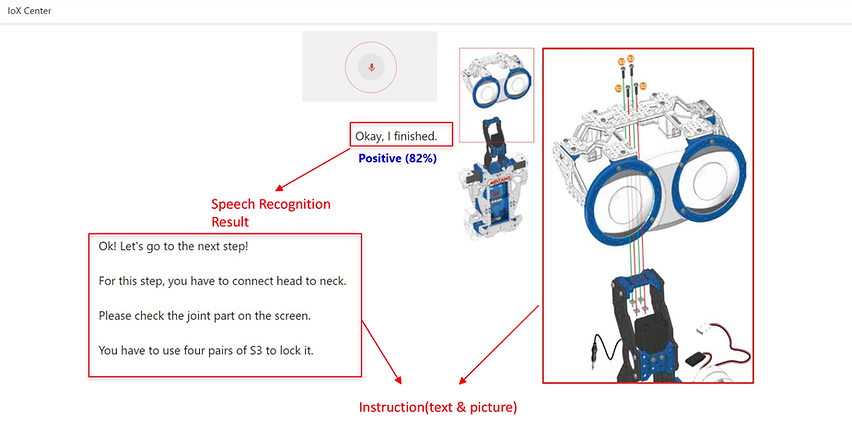

系統介面圖

我們這一個組除了架構多模式聊天機器人之外,同時也在研究如何提升機器人對於人類語言的理解(LU),在這個研究領域當中,我們會使用到大量機器學習的相關技術,特別是強化學習(Reinforcement Learning)方面,利用強化學習可以自主學習的特性來學習如何提升對話系統整體的效能。

在強化學習中有三個重要的概念,狀態(State)、動作(Action)、獎勵(Reward),狀態(State)是用來代表目前對話的現況,透過動作(Action)在不同的狀態(State)之間轉移,當作出優秀的動作(Action)轉移到良好的狀態(State)後給予適當的獎勵(Reward),在如此反覆不斷的自主學習當中,對話系統的效能會被不斷的提升。